Snap dévoile ses futures lunettes AR légères : un ordinateur sur votre visage dès 2026

Si vous effectuez un achat via un lien BGR, nous pouvons percevoir une commission d'affiliation, ce qui aide à financer nos laboratoires d'experts en produits. Les ordinateurs portables – des casques aux lunettes – se sont multipliés ces dernières années, mais ils ne sont pas encore grand public. Des millions de personnes possèdent des casques Meta Quest et PlayStation VR ainsi que des lunettes Ray-Ban Meta, mais ces appareils ne rivalisent pas encore avec les smartphones ou les montres connectées. Il est incertain qu'ils y parviennent un jour, mais avec ses futurs Specs, Snap est convaincu de pouvoir vous inciter à porter des lunettes intelligentes au quotidien.

Les Snap Specs arriveront en 2026. Selon Snap, les Specs sont « un ordinateur portable ultra-puissant intégré dans une paire de lunettes légères à verres transparents ». L'ordinateur intégré à ces lunettes utilise l'apprentissage automatique pour comprendre le monde autour de vous, peut fournir une assistance IA en temps réel dans un espace 3D et permet des expériences partagées avec d'autres utilisateurs de Specs. Snap affirme que le « petit rectangle 2D » dans nos poches n'est pas adapté pour exploiter pleinement la puissance de l'intelligence artificielle. Ils considèrent même les chatbots IA comme un pont vers des expériences immersives en trois dimensions alimentées par l'IA.

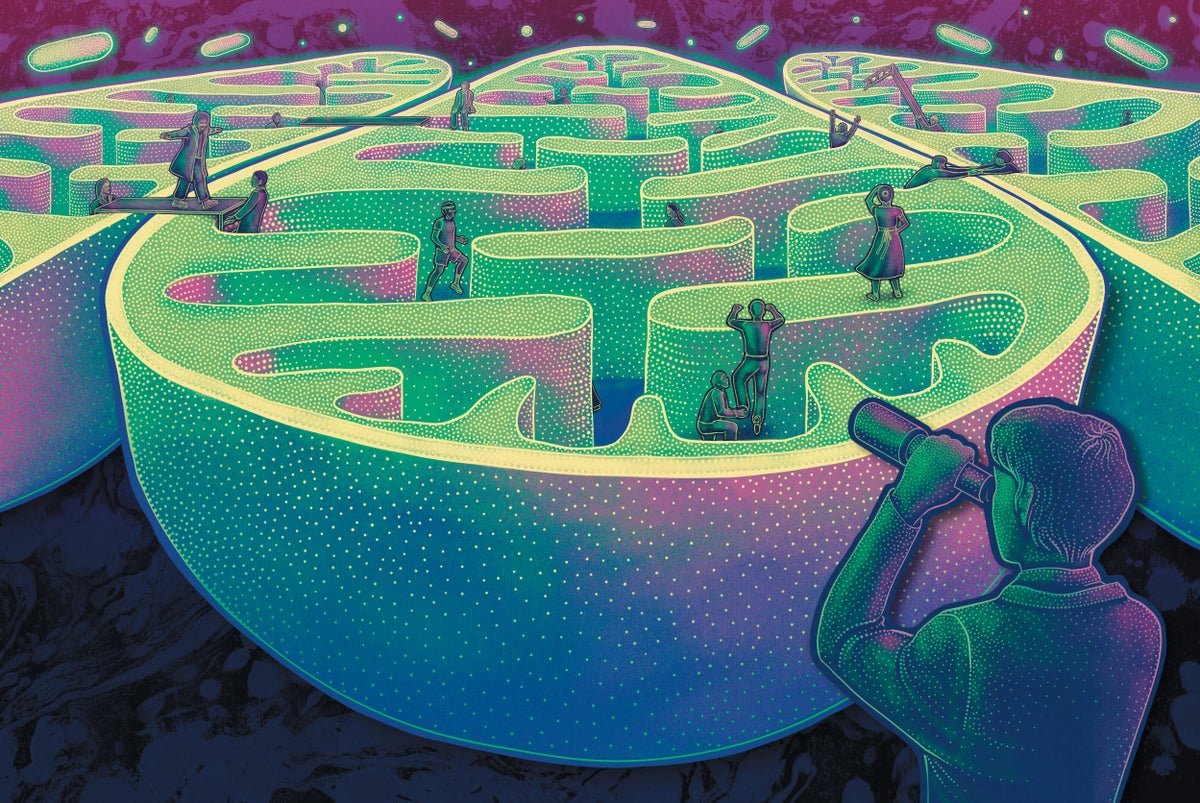

Snap n'est pas encore prêt à dévoiler ses lunettes AR légères (celles que vous voyez en photo en haut de la page sont les Snapchat Spectacles, plus encombrants et destinés aux développeurs), mais l'entreprise prévoit de lancer les Specs en 2026.

Nouvelles fonctionnalités et outils pour Snap OS. En attendant, Snap continue de déployer des mises à jour pour Snap OS, le système d'exploitation qui équipe ses Spectacles. Parmi les nouvelles fonctionnalités de Snap OS figurent des intégrations avec OpenAI et Gemini pour permettre aux développeurs de créer des Lenses multimodales pour les Spectacles, une API de module de profondeur pour traduire des informations 2D des LLM et les afficher avec précision en 3D, la transcription en temps réel pour plus de 40 langues et la possibilité de développer des objets 3D à la volée.

Les développeurs bénéficient également de nouveaux outils dans Snap OS pour créer des expériences basées sur la localisation, comme une application de gestion de flotte pour surveiller plusieurs Specs simultanément, un mode guidé pour lancer directement les Specs dans un Lens solo ou multijoueur, et une navigation guidée pour aider les développeurs à créer des visites guidées en AR que les utilisateurs peuvent suivre en se déplaçant.

Enfin, Snap a annoncé un partenariat avec Niantic Spatial pour construire une carte mondiale partagée alimentée par l'IA et ajoute la prise en charge de WebXR au navigateur.